안녕하세요, 돈 밝히는 머니 엔지니어입니다.

저는 대부분의 주식 투자를 AI 섹터에서 하고 있습니다. 그에 따라 AI 분야의 애널리스트 리포트를 꾸준히 공부하고 있습니다.

그러던 중, 빅테크가 AI에 투자하는 데 얼마나 큰 자본이 들어가는지에 대해 흥미로운 내용의 리포트를 발견하였습니다. 그 내용 중 일부를 여러분들께도 소개드리고자 합니다.

AI 투자에 들어가는 돈에 대해 궁금하셨던 분들은 아래 내용을 읽어보신다면 저와 마찬가지로 큰 도움을 받으실 겁니다.

아래 내용은 한화투자증권에서 발간한 'AI 경쟁의 제2막, 확산'이라는 애널리스트 리포트의 내용을 바탕으로 공부한 것들이니, 참고해 주시면 감사하겠습니다.

Chat GPT, 성능 좋아질수록 비싸져

모두들 아시다시피, 빅테크들은 지난 2년간 AI 분야에 경쟁적으로 투자해왔습니다. 그 결과 Chat GPT 또는 Gemini와 같은 유용한 AI 모델이 개발되기도 했습니다. 그러나 이러한 투자와 발전은 동시에 비용 증가로 이어지기도 했습니다.

혹시 매개변수와 토큰이라는 단어를 들어보셨나요?

매개변수란 AI가 무언가를 학습하는 과정을 외부 개입을 통해 조절하는 일종의 커스터마이징 같은 것입니다.

우리가 노래를 들을 때, 음향을 크게 또는 작게 조절하거나 콘서트장처럼 울리게 만들 수 있습니다. 이와 마찬가지로 AI 학습에 있어서도 이러한 조건을 추가하여 학습 결과를 다양하게 만드는 것입니다.

또한 토큰이란 AI 모델이 언어를 분석하는 최소 단위를 말합니다. LLM(Large Language Model, 초대형 언어모델)은 언어에 대한 이해를 바탕으로 작동합니다. 그러므로 토큰은 LLM이 존재하기 위한 근본적인 요소라고 할 수 있습니다.

예를 들면 "나는 밥을 먹었다" 라는 문장이 있다면 "나는"과 "밥을 먹었다"은 해당 문장에 있어서 토큰에 해당합니다.

AI 모델을 고도화하기 위해서도 매개변수와 토큰을 마구마구 늘릴수록 유리합니다. 그런데 매개변수와 토큰이 늘어날수록 학습 비용 역시 증가합니다. AI를 학습에 동원되는 장치들이 일을 더 많이 해야 하기 때문이죠. 즉, AI 모델의 성능이 좋아질수록 돈이 더 많이 드는 셈입니다.

인프라 고도화 역시 유지비 부담

AI 개발에는 학습만 필요한 게 아닙니다. 학습 시스템을 작동시키기 위한 설비에 대한 투자 역시 중요합니다. 그래서 빅테크는 데이터센터와 그 안의 AI 서버 등과 같은 인프라에도 꾸준히 투자해 왔습니다.

그런데 우리가 비싼 자동차를 사면 타이어도 좋은 걸 끼워줘야 하듯이, 투자를 통해 AI 서버의 성능이 높아지면 전력비와 같은 운영비가 발생합니다.

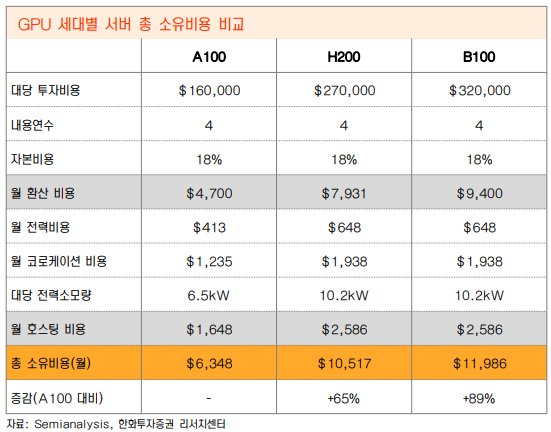

예컨대 엔비디아에서 출시 예정인 B100(일명 Blackwell Architecture, 블랙웰)을 기반으로 한 AI 서버의 운영비는 이전 모델인 A100 서버 대비 약 60%가 증가할 것으로 추정됩니다.

컴퓨팅 파워, 너마저..

또한 고성능 AI 모델을 작동시키기 위해서는 고도의 컴퓨팅 파워가 요구됩니다. 컴퓨팅 파워란 AI 모델이 정보를 다루는 속도를 말합니다. 1 엑사플롭의 컴퓨팅 파워는 1초에 100경 번에 달하는 연산을 수행할 수 있는 성능에 해당합니다.

고성능의 컴퓨팅 파워를 제공하기 위해서는 대량의 GPU가 필요합니다. 예를 들어 GPT-4의 경우 컴퓨팅 파워를 감당하기 위해 엔비디아의 A100 칩 2만 개가 동원되었습니다. A100 칩 2만 개에 해당하는 AI 클러스터 구축에는 1조 원 이상이 소요되는 것으로 추정됩니다.

잘 키운 AI 모델 하나, 대중화되면 '돈 먹는 하마'

무엇보다 고성능의 컴퓨팅 파워는 또다시 추론비용의 상승을 낳습니다.

AI 학습을 위해 토큰 수를 늘리며 학습비용을 부담했다면, AI가 다 크고 나서는(?) 학습한 정보를 바탕으로 연산을 실행하기 위한 비용을 또 요구하는 셈입니다.

또한 그런 AI 모델이 확산되며 동시 사용자 수가 늘어난다면, 추론비용은 더 증가하게 됩니다.

결론적으로 AI에 대한 투자는 시작부터 끝까지 돈이 돈을 잡아먹는 구조인 셈입니다. 그러나 빅테크도 이 사실을 모르지 않습니다. 그들도 결국 돈을 벌기 위해 그러한 투자를 단행해오고 있는 것입니다.

그러나 아직까지는 개발해 온 AI 모델을 통해 돈을 많이 벌지는 못했습니다. 오히려 데이터센터와 같은 AI 인프라 회사들이 돈을 많이 벌었죠.

그러나 최근, AI에 진심인 회사들은 AI로 돈을 버는 '편법'을 알아냈습니다. 바로 SLM이라는 새로운 AI 모델을 통해서입니다. 다음 포스팅에서는 이 SLM에 대해서 공부해 보고 여러분들께 알려드리도록 하겠습니다. 읽어주셔서 감사합니다.

'경제 이야기 > 쉬운 주식 이야기' 카테고리의 다른 글

| 온 디바이스 AI가 가져올 변화와 주가 전망 (1) | 2024.11.07 |

|---|---|

| 온 디바이스 AI에 대해 알아보자. (3) | 2024.11.06 |

| AI 산업의 구조(밸류 체인)를 통해 주가 전망을 알아보자. (5) | 2024.11.04 |

| SLM(Small Language Model)이 무엇인지 알아보자. (2) | 2024.10.29 |

| 미국 반도체 ETF(SOXX, SMH 등)에 계속 투자해야 하는가? 주식 전망 체크! (2) | 2024.10.25 |